为防止,一些小网站私自盗用原文,请支持原创

原文永久链接:http://qindongliang1922.iteye.com/blog/1922742

前面几章笔者把Lucene基本入门的任督二脉给打通了,从此篇开始,就开始进行Lucene的进阶开发了,那么首先摆在我们面前的第一个必须要解决的问题,就是关于中文分词的问题,因为Lucene毕竟是国外的大牛们开发的,显然会比较侧重英文文章,不过还好,在Lucene的下载包里同步了SmartCN的分词器针对中文发行的,每一次Lucene有新的版本发行,这个包同时更新。

笔者比较推荐的中文分词器是IK分词器,在进入正式的讲解之前,我们首先对Lucene里面内置的几个分析器做个了解.

分析器类型基本介绍WhitespaceAnalyzer以空格作为切词标准,不对语汇单元进行其他规范化处理SimpleAnalyzer以非字母符来分割文本信息,并将语汇单元统一为小写形式,并去掉数字类型的字符StopAnalyzer该分析器会去除一些常有a,the,an等等,也可以自定义禁用词StandardAnalyzerLucene内置的标准分析器,会将语汇单元转成小写形式,并去除停用词及标点符号CJKAnalyzer能对中,日,韩语言进行分析的分词器,对中文支持效果一般。SmartChineseAnalyzer对中文支持稍好,但扩展性差

评价一个分词器的性能优劣,关键是看它的切词效率以及灵活性,及扩展性,通常情况下一个良好的中文分词器,应该具备扩展词库,禁用词库和同义词库,当然最关键的是还得要与自己的业务符合,因为有些时候我们用不到一些自定义词库,所以选择分词器的时候就可以不考虑这一点。IK官网发布的最新版IK分词器对于Lucene的支持是不错的,但是对于solr的支持就不够好了,需要自己改源码支持solr4.x的版本。笔者使用的另一个IK包是经过一些人修改过的可以支持solr4.3的版本,并对扩展词库,禁用词库,同义词库完全支持,而且在solr里面配置很简单,只需要在schmal.xml进行简单配置,即可使用IK分词器的强大的定制化功能。不过官网上IK作者发布的IK包在lucene里面确都不支持同义词库扩展的功能,如果你想使用,得需要自己修改下源码了,不过即使自己修改扩展同义词也是非常容易的。

下面笔者给出使用官网最后一版发布的IK在Lucene中做的测试,笔者使用的已经扩展了同义词库部分,后面会给出源码。

下面先看第一个纯分词的测试

class="java" name="code">

package com.ikforlucene;

import java.io.StringReader;

import org.apache.lucene.analysis.TokenStream;

import org.apache.lucene.analysis.tokenattributes.CharTermAttribute;

public class Test {

public static void main(String[] args)throws Exception {

//下面这个分词器,是经过修改支持同义词的分词器

IKSynonymsAnalyzer analyzer=new IKSynonymsAnalyzer();

String text="三劫散仙是一个菜鸟";

TokenStream ts=analyzer.tokenStream("field", new StringReader(text));

CharTermAttribute term=ts.addAttribute(CharTermAttribute.class);

ts.reset();//重置做准备

while(ts.incrementToken()){

System.out.println(term.toString());

}

ts.end();//

ts.close();//关闭流

}

}

运行结果:

三

劫

散

仙

是

一个

菜鸟

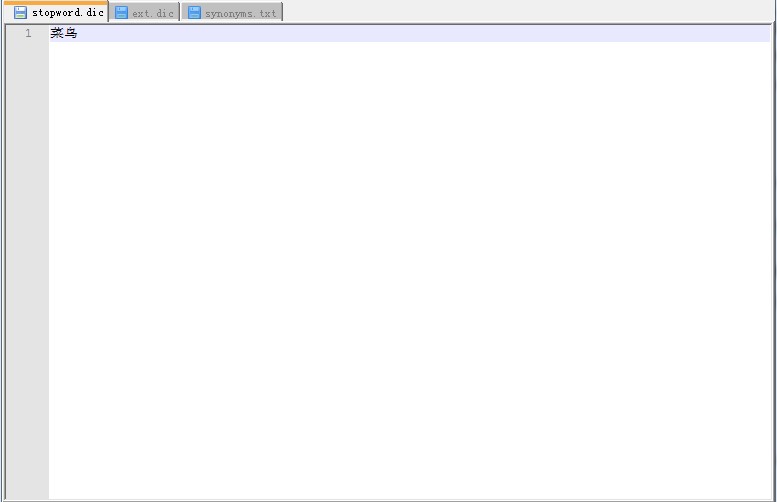

第二步,测试扩展词库,使三劫为一个词,散仙为一个词,需要在同义词库里添加三劫,散仙(注意是按行读取的),注意保存的格式为UTF-8或无BOM格式即可

添加扩展词库后运行结果如下:

添加扩展词库后运行结果如下:

三劫

散仙

是

一个

菜鸟

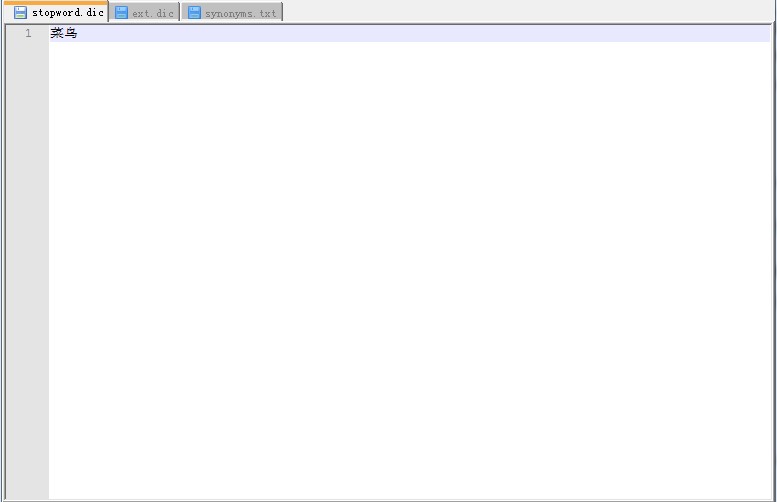

第三步,测试禁用词库,我们把菜鸟二个字给屏蔽掉,每行一个词,保存格式同上.

添加禁用词库后运行结果如下:

添加禁用词库后运行结果如下:

三劫

散仙

是

一个

最后我们再来测试下,同义词部分,现在笔者把河南人,洛阳人作为"一个"这个词的同义词,添加到同义词库中(笔者在这里仅仅是做一个测试,真正生产环境中的同义词肯定是正式的),注意同义词,也是按行读取的,每行的同义词之间使用逗号分割。

添加同义词库后运行结果如下:

添加同义词库后运行结果如下:

三劫

散仙

是

一个

河南人

洛阳人

至此,使用IK在Lucene4.3中大部分功能都已测试通过,下面给出扩展同义词部分的源码,有兴趣的道友们,可以参照借鉴下。

package com.ikforlucene;

import java.io.IOException;

import java.io.Reader;

import java.util.HashMap;

import java.util.Map;

import org.apache.lucene.analysis.Analyzer;

import org.apache.lucene.analysis.Tokenizer;

import org.apache.lucene.analysis.synonym.SynonymFilterFactory;

import org.apache.solr.core.SolrResourceLoader;

import org.wltea.analyzer.lucene.IKTokenizer;

/**

* 可以加载同义词库的Lucene

* 专用IK分词器

*

*

* */

public class IKSynonymsAnalyzer extends Analyzer {

@Override

protected TokenStreamComponents createComponents(String arg0, Reader arg1) {

Tokenizer token=new IKTokenizer(arg1, true);//开启智能切词

Map<String, String> paramsMap=new HashMap<String, String>();

paramsMap.put("luceneMatchVersion", "LUCENE_43");

paramsMap.put("synonyms", "E:\\同义词\\synonyms.txt");

SynonymFilterFactory factory=new SynonymFilterFactory(paramsMap);

SolrResourceLoader loader= new SolrResourceLoader("");

try {

factory.inform(loader);

} catch (IOException e) {

// TODO Auto-generated catch block

e.printStackTrace();

}

return new TokenStreamComponents(token, factory.create(token));

}

}

关于同义词部分的使用,各位道友,可以先去官网上下载源码,然后将此同义词扩展部分放进去即可,非常简单方便。

- 大小: 18.6 KB

- 大小: 19.9 KB

- 大小: 19.6 KB