Google 一直希望通过优化反垃圾网站算法来完善搜索引擎,让质量低、含有垃圾内容的网页排名降低,使高质量的内容得到应有的好的排名。虽然一切看起来很美很正义,但是在实际运行中它现在似乎也存在着一些问题。

企鹅是 Google 诸多反垃圾算法中的一种,Google 通过它惩罚那些通过过分 SEO 手段提高排名的网站,同时也降低那些充斥广告网站的排名。起初它的确起了一定优化搜索的作用,可是当它遇到“black hat webspam”,也就是一些黑客直接侵入优秀原创的网站,将其链接到自己的网页,借用这些网站的良好声誉,让自己的搜索排名产生垃圾网站时,它会同时降低那些原创网站的搜索排名。

这本来也不是一件大事,因为它反而迫使那些优质网站更加注重自身网站管理,摆脱网站上无关链接,但问题出在 Google 对于企鹅长达近十个月的不更新,让那些已经做出修改的网页仍遭受排名较后的调整,虽然其中有些网站已经通过大量的人力物力爬回了排名前端,但是在整件事中它们并没有做错什么就受到无辜的波及。

针对 Google 的反垃圾算法,Buehler 也宣称自己是受害者之一。在同类搜索中,排名较后的网站想要超越排名较前的网站时,只需通过“black hat SEO”技术攻击对方网页就能迅速获得较前的排名。但经过调查后,Google 认为并没有证据证明这是一个十分严重的问题。

我们抽丝剥茧仔细研究一下会发现 Google 的反垃圾算法之所以会遇到种种问题最本质的在于 Google 看待问题的方式,它陷入了一种晕轮效应,这种强烈知觉的品质或特点,就象月亮形式的光环一样,向周围弥漫、扩散,从而掩盖了其它品质或特点。在 Google 设计算法中它所期望解决的问题是使低质量网站排名靠后,这样一来它就需要面临如上文所说的种种问题,但是它真正需要解决的是如何让高质量网站的排名靠前。

这两点最大的区别在于对象,就某种程度而言它们并没有本质区别,在处理结果上它们是一样的,但是在处理问题过程中这却是十分重要的事,Google 千方百计地希望找出垃圾网站的特征从而做出惩罚,但这一个没有尽头的事情,因为无论是限制关键词数量,还是倡导运用白帽手,它们都无法阻止黑客寻找新的方法破解,而 Google 总需要不停地做出应对,但是如果 Google 将算法的重心放在根据基于时间顺序算法,通过时间轴找出原创内容最早出处通过,进行搜索优化,或许这样处理将它变成一件比较轻松的事。

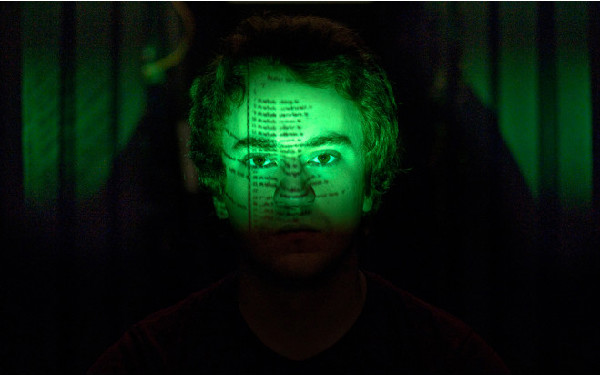

题图来自 wired